ubuntu 安装配置 ollama ,添加open-webui

ubuntu 安装配置 ollama

- 下载安装 [https://ollama.com/download](https://ollama.com/download)

- 一 安装方法 1 命令行下载安装

- 一 安装方法 2 , 手动下载安装

- 二 配置模型下载路径

- 三 运行

- 1 启动 ollama 服务

- 2 运行大模型

- 四 添加开机自启服务 ollama serve

- 1 关闭 ollama 服务

- 2 修改配置文件

- 五 重新加载配置

- 六 重启ollama serve

- 七 查看模型文件信息路径

- 八 添加open-webui

- 方法1,docker 拉取现有的镜像,创建容器运行

- 方法2,open-webui源码构建docker镜像

下载安装 https://ollama.com/download

一 安装方法 1 命令行下载安装

curl -fsSL https://ollama.com/install.sh | sh

一 安装方法 2 , 手动下载安装

1 手动下载 https://ollama.com/install.sh 这个文件

2 注释掉下载部分 curl xxxx 手动下载ollama-linux-{ARCH}

status "Downloading ollama..." #curl --fail --show-error --location --progress-bar -o $TEMP_DIR/ollama "https://ollama.com/download/ollama-linux-${ARCH}${VER_PARAM}"我电脑intel/amd cpu 所以 {ARCH} = amd64

浏览器下载 https://ollama.com/download/ollama-linux-amd64

放在 install.sh 同目录下

3 注释掉 #$SUDO install -o0 -g0 -m755 $TEMP_DIR/ollama $BINDIR/ollama

改为下面一行:

status "Installing ollama to $BINDIR..." $SUDO install -o0 -g0 -m755 -d $BINDIR #$SUDO install -o0 -g0 -m755 $TEMP_DIR/ollama $BINDIR/ollama $SUDO install -o0 -g0 -m755 ./ollama-linux-amd64 $BINDIR/ollama

4 运行 install.sh ,安装

./install.sh

需要sudo 权限, 安装完毕

二 配置模型下载路径

gedit .bashrc

然后添加一行 配置 OLLAMA_MODELS 环境变量自定义路径

### ollama model dir 改为自己的路径 export OLLAMA_MODELS=/path/ollama_cache

添加目录权限:

chown `你的linux用户:你的linux用户组` /path/ollama_cache

如果开始没配置OLLAMA_MODELS ,默认路径是

/usr/share/ollama/.ollama/models

如果修改了OLLAMA_MODELS环境变量,把之前下载的 OLLAMA_MODELS 目录变量下的两个目录

blobs manifests

复制到新的OLLAMA_MODELS目录变量下 ,即可

三 运行

1 启动 ollama 服务

ollama serve

2 运行大模型

ollama run

运行 千问 大模型

ollama run qwen

模型下载到刚才的OLLAMA_MODELS 环境变量下

=========================================================================================================

四 添加开机自启服务 ollama serve

1 关闭 ollama 服务

service ollama stop

2 修改配置文件

sudo gedit /etc/systemd/system/ollama.service

1 把User改为 你的linux系统用户名 ,Group 改为 你的linux用户组

2 添加 Environment="OLLAMA_MODELS=/path/ollama_cache" 改为你的路径

[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/local/bin/ollama serve User=你的linux用户名 Group=你的linux用户组 Restart=always RestartSec=3 Environment="OLLAMA_MODELS=/path/ollama_cache" Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/snap/bin" [Install] WantedBy=default.target

五 重新加载配置

sudo systemctl daemon-reload

六 重启ollama serve

sudo systemctl start ollama

七 查看模型文件信息路径

ollama show --modelfile

ollama show qwen --modelfile

八 添加open-webui

确保网络代理关闭 ubuntu 系统,设置,网络代理,选择->关闭

参考 官方文档 https://docs.openwebui.com/getting-started/

以下容器 运行之后,需要等一会,再访问 http://127.0.0.1:8080/

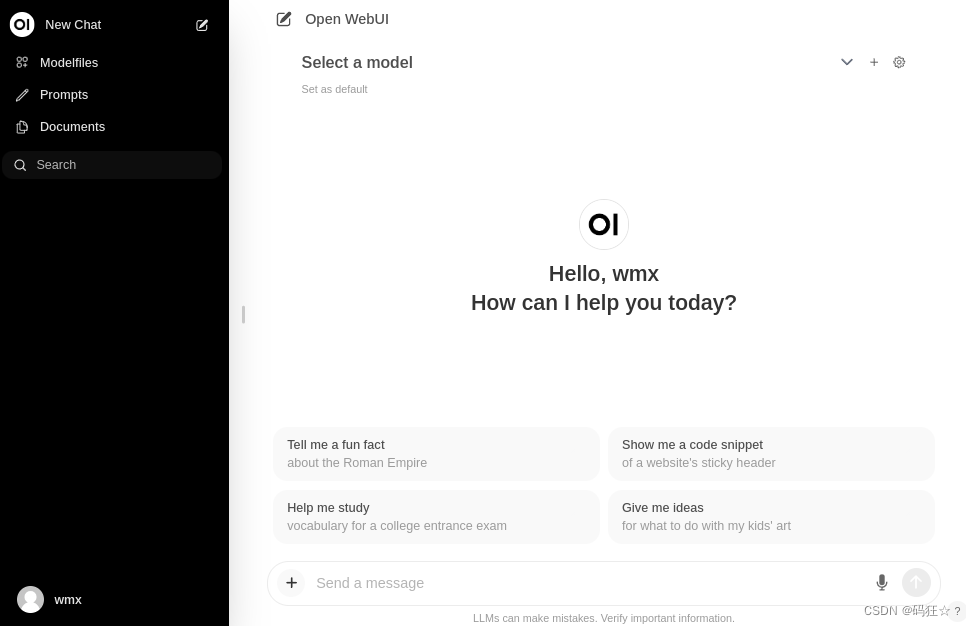

注册 open-webui 账号然后用账号登录,效果如下:

方法1,docker 拉取现有的镜像,创建容器运行

OLLAMA_BASE_URL 指定 ollama 服务地址 ,可以是本地也可以是远端

docker run -d --network=host -v open-webui:/app/backend/data -e OLLAMA_BASE_URL=http://127.0.0.1:11434 --name open-webui --restart always ghcr.io/open-webui/open-webui:main

方法2,open-webui源码构建docker镜像

下载open-webui 源码

https://github.com/open-webui/open-webui

编译运行open-webui 的 Docker 镜像

./run-compose.sh --enable-gpu --build