NLP:spacy库安装与zh

到公司来第一个项目竟然是偏文本信息抽取与结构化的,(也太高看我了┭┮﹏┭┮)

反正给机会了就上吧,我就一臭实习的,怕个啥。配置了两天的环境,也踩了不少坑,我把我的经历给大家分享一下:

- 首先确定zh_core_web_sm版本:

安装路径

(当然你可以换一个模型,我这里是以zh_core_web_sm为例,因为它下载容量小一些,不过精确率也稍微差一点,想追求效果好的可以试试zh_core_web_trf-3.7.0他是基于特征抽取器Tranformer,有想了解这方面背景故事的小伙伴可以看看这位大佬的博客:NLP12篇核心文章)

这一步非常重要,因为只有确定了他的版本号,才可以往后面去下载spacy,因为你如果后面两个版本对不上,执行代码的时候就会显示找不到zh_core_web_sm。记录你的版本号,之后按照这个博主的流程下载:下载流程。

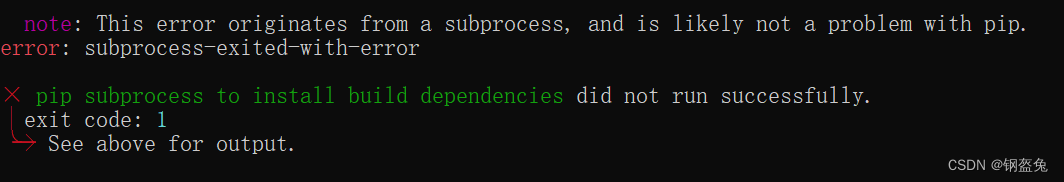

而且注意版本最好不要太低,我一开始安装的是3.1.0的,但是后面安装spacy的时候就安装不上了(会报下面的错),最后换成3.7.0的就好了

如果后续有报错的话可以尝试加上下一步的镜像去下载,虽然不知道为什么,但是加上了确实可以解决我的问题

- 之后安装spacy,先在终端输入下面四行指令

(这里最好使用anconda创建一个新的虚拟环境,防止串包,因为下载的东西有点多。anconda创建切换环境)

pip install -U pip setuptools wheel pip install -U spacy==之前记录下来的版本号 pip install spacy-transformers python3 -m spacy download zh_core_web_trf

这里直接用的话就会很慢,最好后面补充镜像去下载:

pip install 库名 -i https://pypi.tuna.tsinghua.edu.cn/simple

如果加上了还显示连接超时的话,可能就是公司的网络太慢了,可以连一下自己的热点试试

- 之后安装spacy,先在终端输入下面四行指令

免责声明:我们致力于保护作者版权,注重分享,被刊用文章因无法核实真实出处,未能及时与作者取得联系,或有版权异议的,请联系管理员,我们会立即处理!

部分文章是来自自研大数据AI进行生成,内容摘自(百度百科,百度知道,头条百科,中国民法典,刑法,牛津词典,新华词典,汉语词典,国家院校,科普平台)等数据,内容仅供学习参考,不准确地方联系删除处理!

图片声明:本站部分配图来自人工智能系统AI生成,觅知网授权图片,PxHere摄影无版权图库和百度,360,搜狗等多加搜索引擎自动关键词搜索配图,如有侵权的图片,请第一时间联系我们,邮箱:ciyunidc@ciyunshuju.com。本站只作为美观性配图使用,无任何非法侵犯第三方意图,一切解释权归图片著作权方,本站不承担任何责任。如有恶意碰瓷者,必当奉陪到底严惩不贷!